Énergie - AI Energy Solutions

LSTM vs Transformer : Prévision énergétique sur Smart Grid

Fictif

|

03/01/2026 > 21/01/2026

Contexte

J'ai été mandaté par AI Energy Solutions (fictif), une entreprise de réseau intelligent gérant 50 000 foyers en Île-de-France, pour développer un système de prévision basé sur le deep learning pour l'achat quotidien d'énergie sur le marché spot EPEX.

Mon rôle :

- Comparer les architectures LSTM et Transformer pour la prévision de la consommation sur 24 heures.

- Concevoir des fonctionnalités combinant les modèles historiques, les données météorologiques et les événements calendaires.

- Atteindre une précision de prévision inférieure à 0,5 kW MAE afin de réduire les pertes annuelles (62,5 millions d'euros dues à un approvisionnement excédentaire ou insuffisant).

Datasets

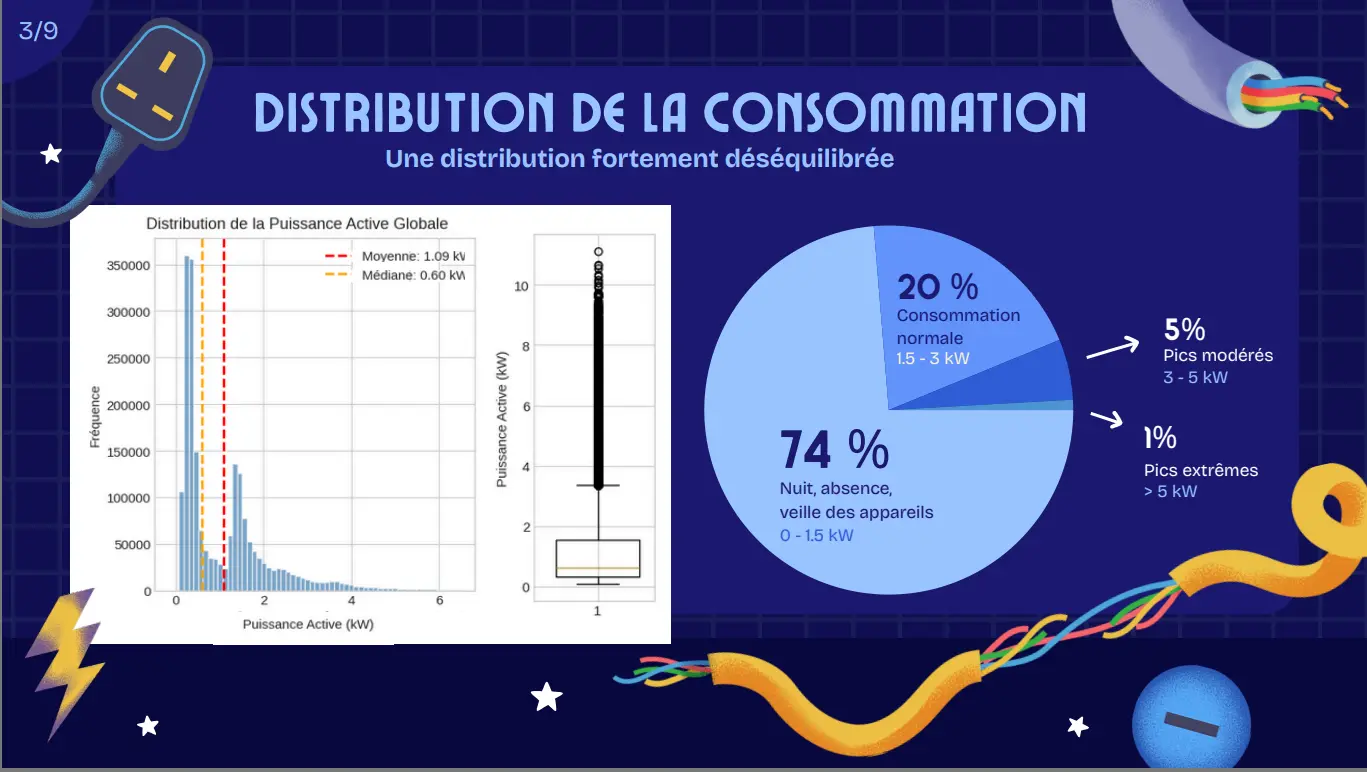

Consommation électrique individuelle des ménages de l'UCI : données réelles d'un ménage à Sceaux (banlieue parisienne), de décembre 2006 à novembre 2010.

2 049 280 observations à la minute près → 34 589 observations horaires après agrégation.

7 variables : puissance active/réactive globale, tension, intensité, 3 sous-compteurs.

Cible : puissance active globale (kW).

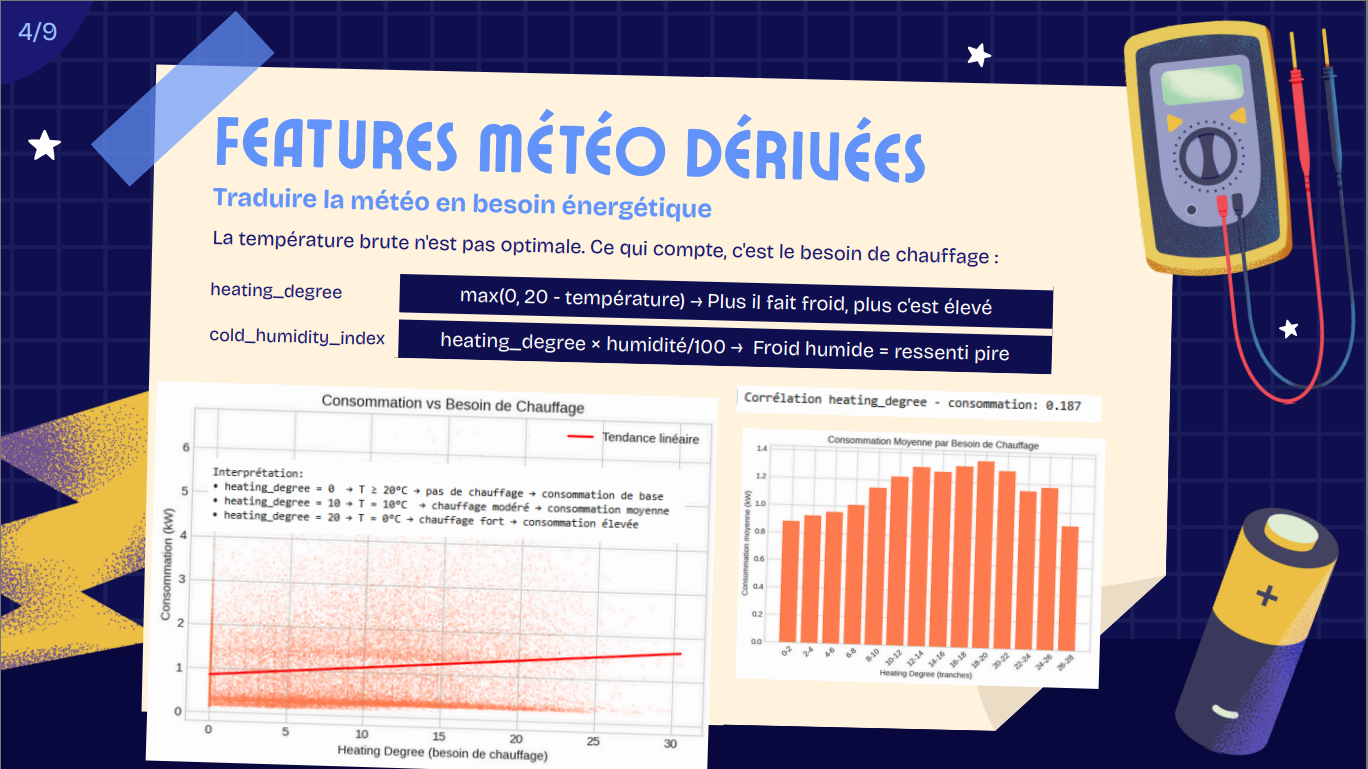

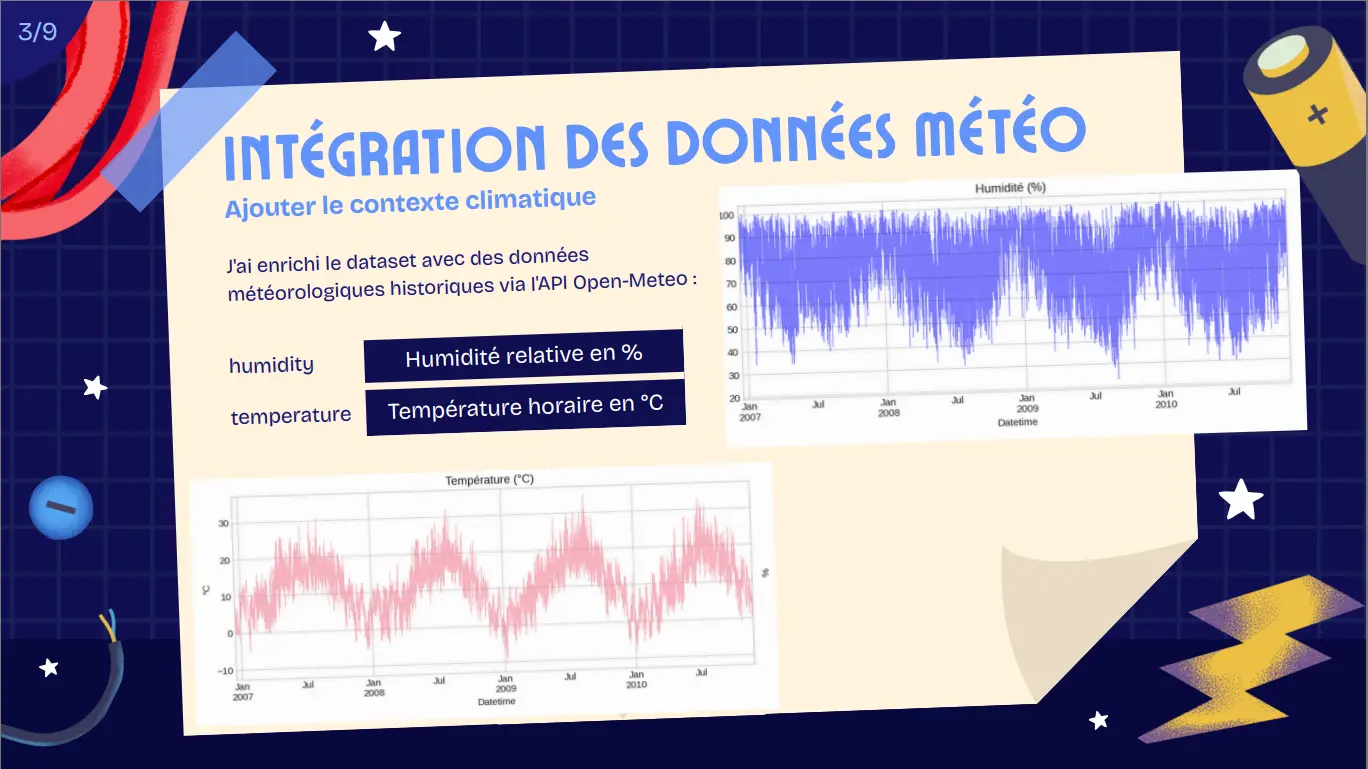

Données météorologiques externes : API Open-Meteo (Sceaux) → Degré de chauffage, humidité, indice d'humidité froide

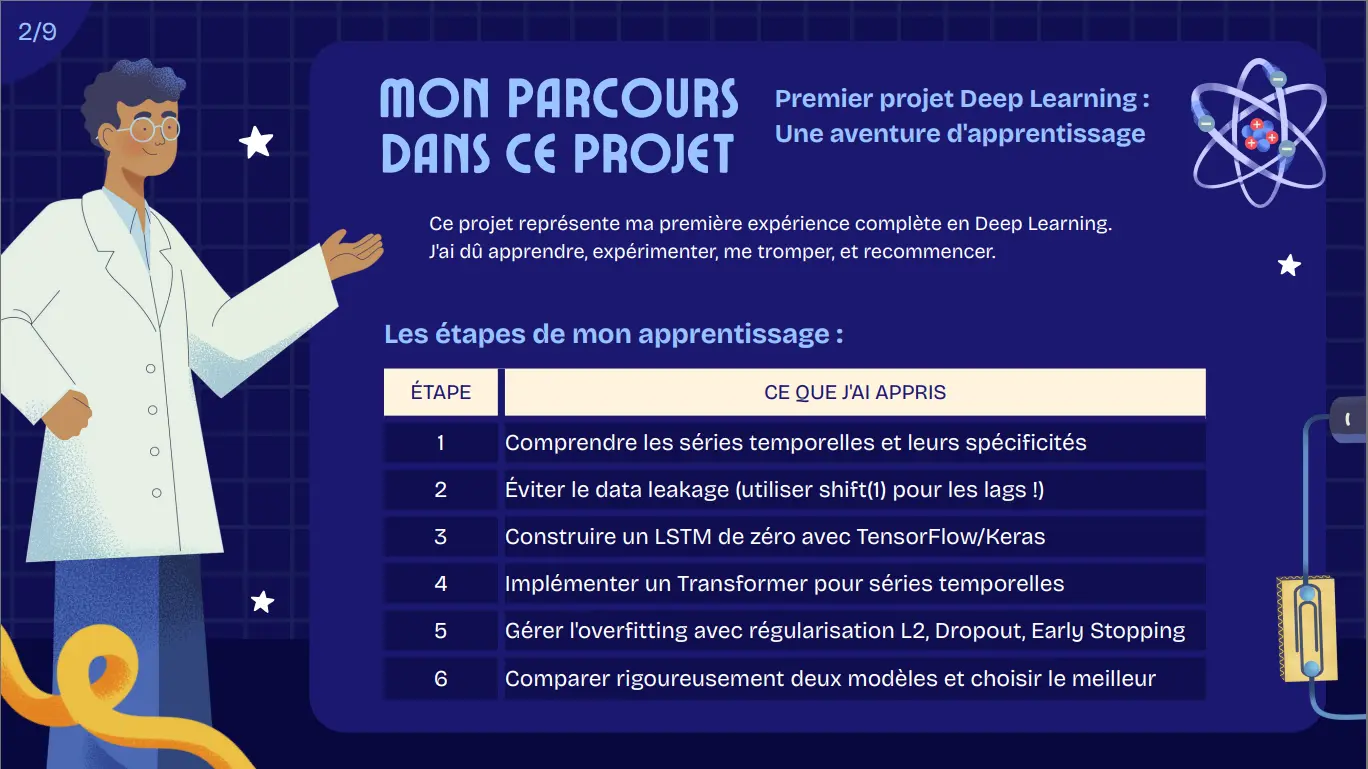

Workflow

Environnement : Google Colab (Python 3), TensorFlow/Keras, pandas, scikit-learn, GPU T4

Préparation des données :

- Rééchantillonnage horaire, suppression des valeurs manquantes (1,25 %)

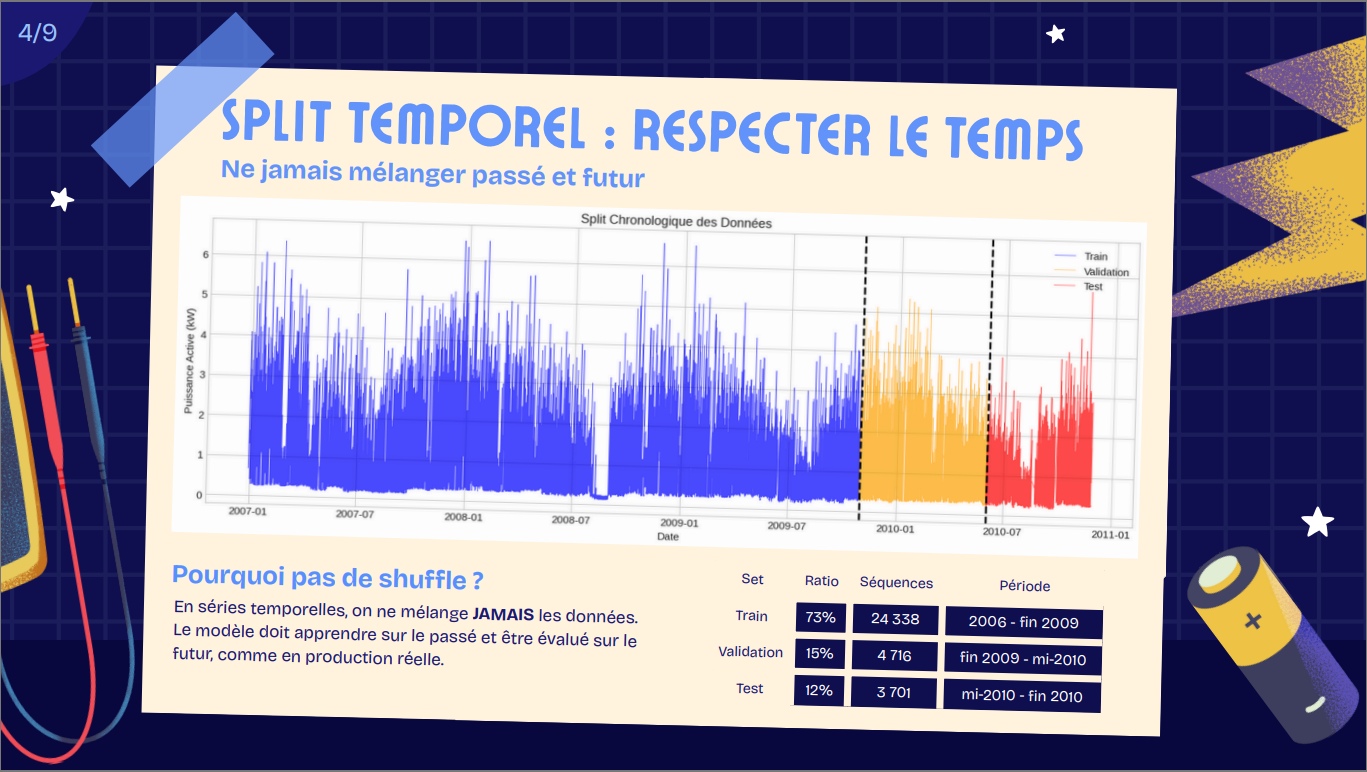

- Division temporelle : Entraînement 73 % (2006-2009) / Validation 15 % / Test 12 % (2010)

- Fenêtre glissante : 336 h d'entrée (2 semaines) → 24 h de sortie

- Normalisation MinMaxScaler (ajustée uniquement sur l'entraînement)

Ingénierie des caractéristiques (34 caractéristiques) :

- Caractéristiques de décalage : 1 h, 2 h, 3 h, 6 h, 12 h, 24 h, 48 h, 168 h, 336 h

- Statistiques glissantes : moyenne (6 h, 12 h, 24 h, 168 h, 336 h), std/min/max (24 h)

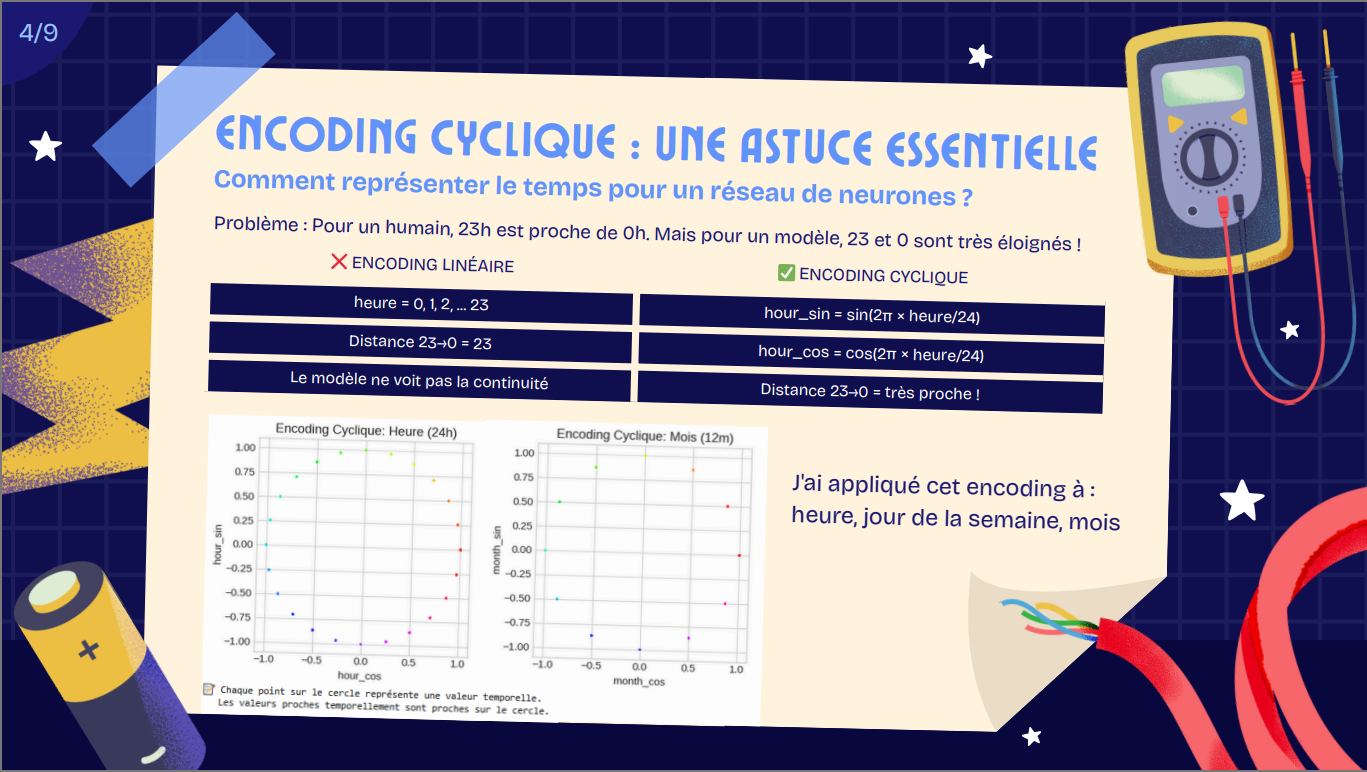

- Codage cyclique : heure, jour de la semaine, mois (sin/cos)

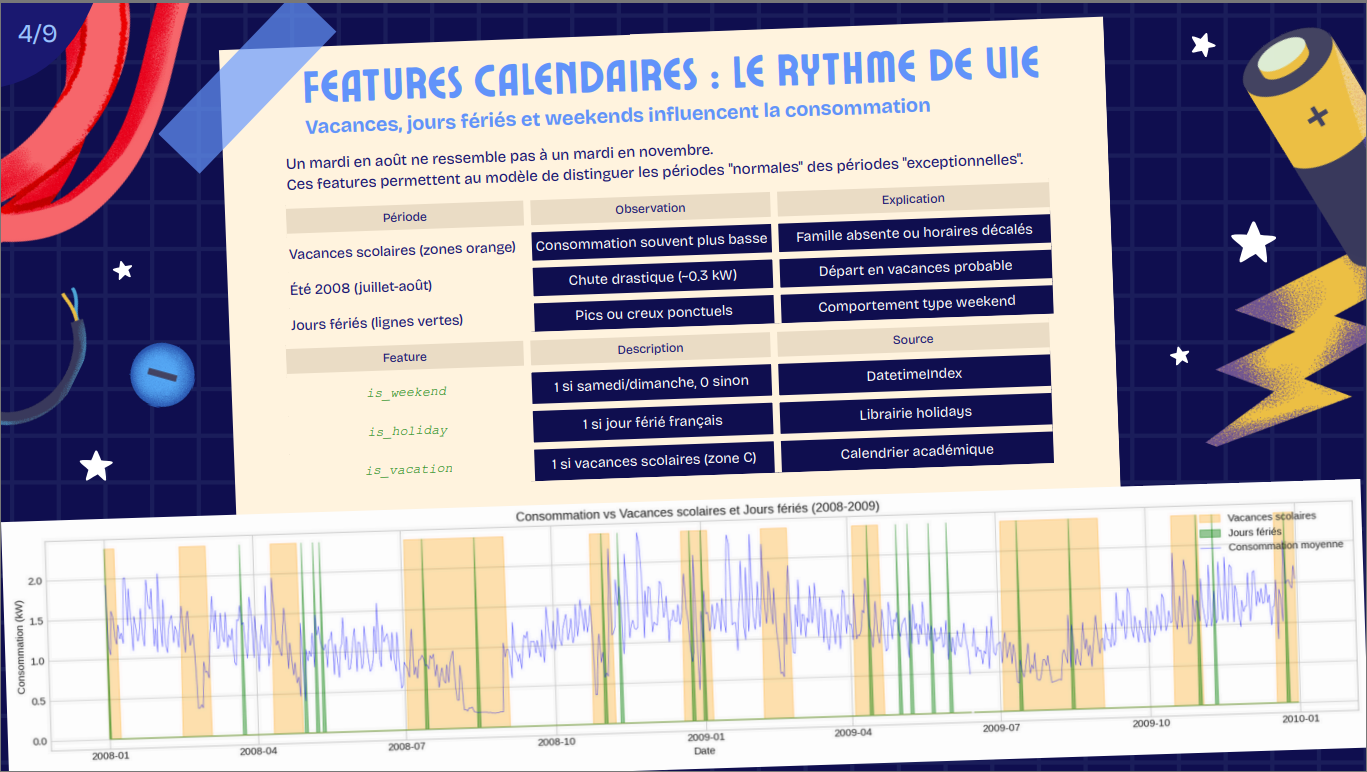

- Calendrier : is_weekend, is_holiday, is_vacation

- Météo : degré de chauffage (base 20 °C), humidité, indice d'humidité froide

Développement du modèle :

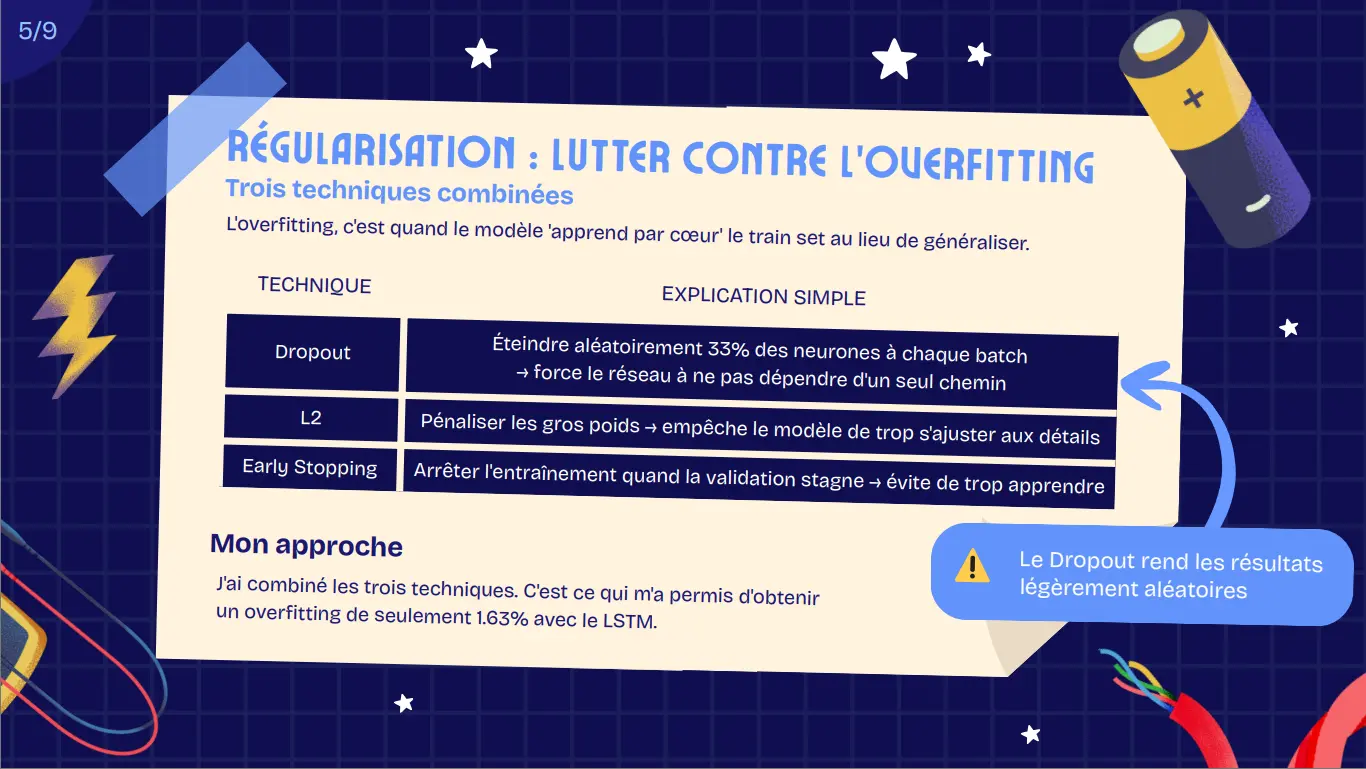

- LSTM : 2 couches (64, 32 unités), dropout 0,33, arrêt précoce (callback)

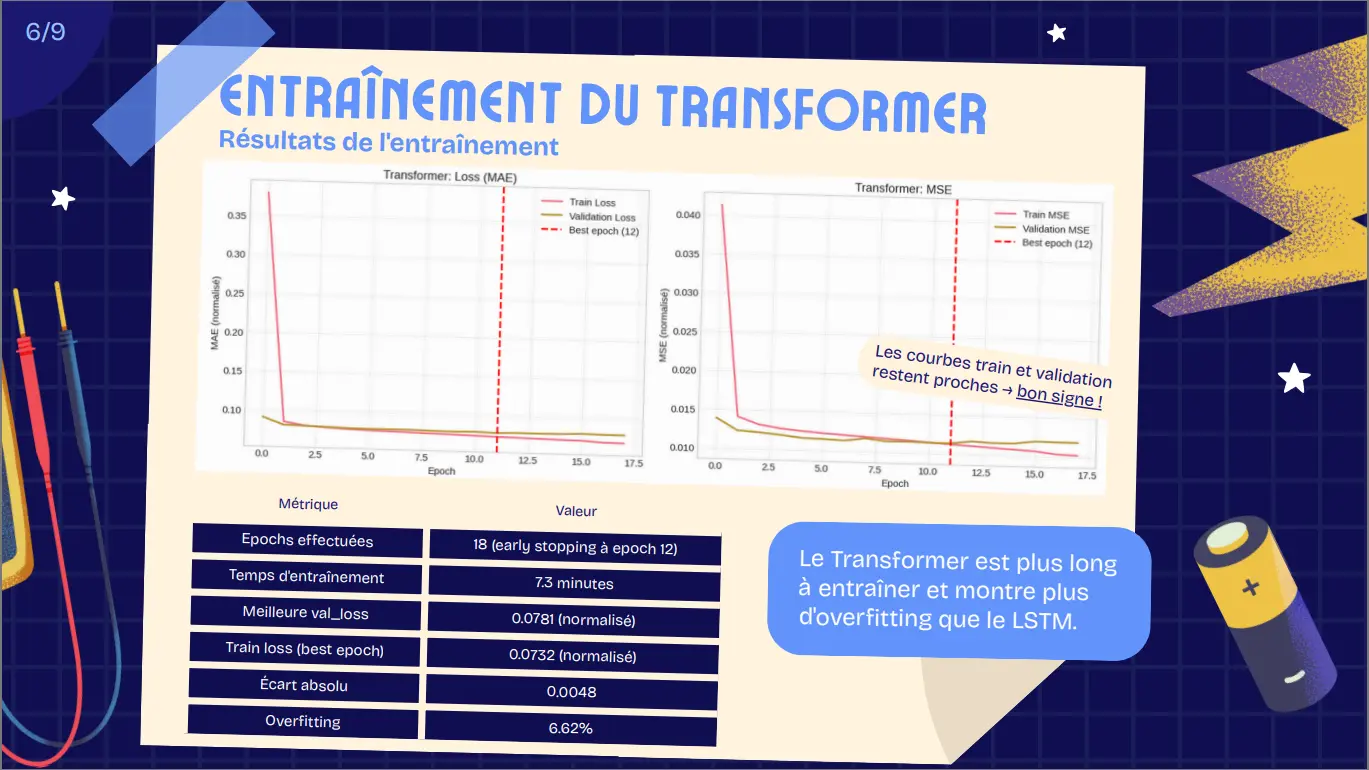

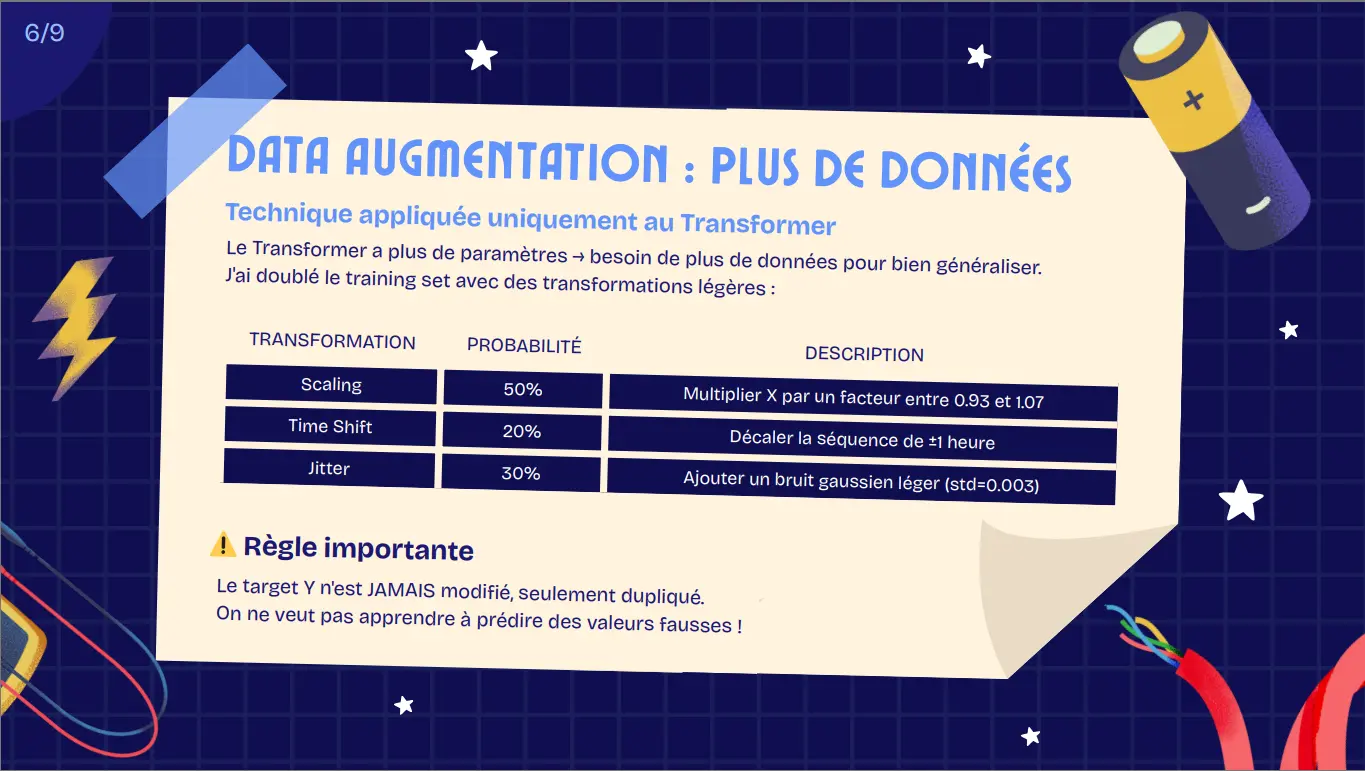

- Transformer : 2 couches d'encodeur, 1 encodage positionnel, 4 têtes, d_model=64, L2 reg, dropout 0,35

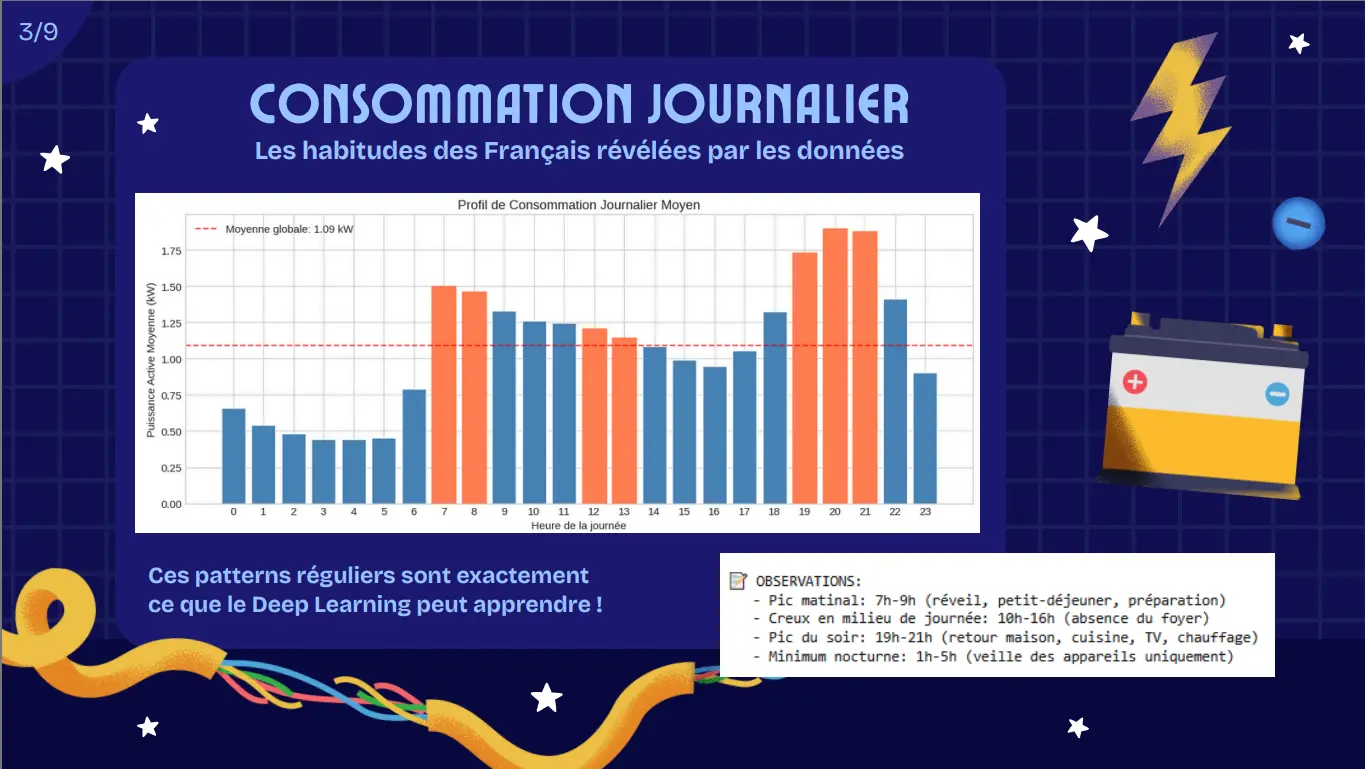

Insights

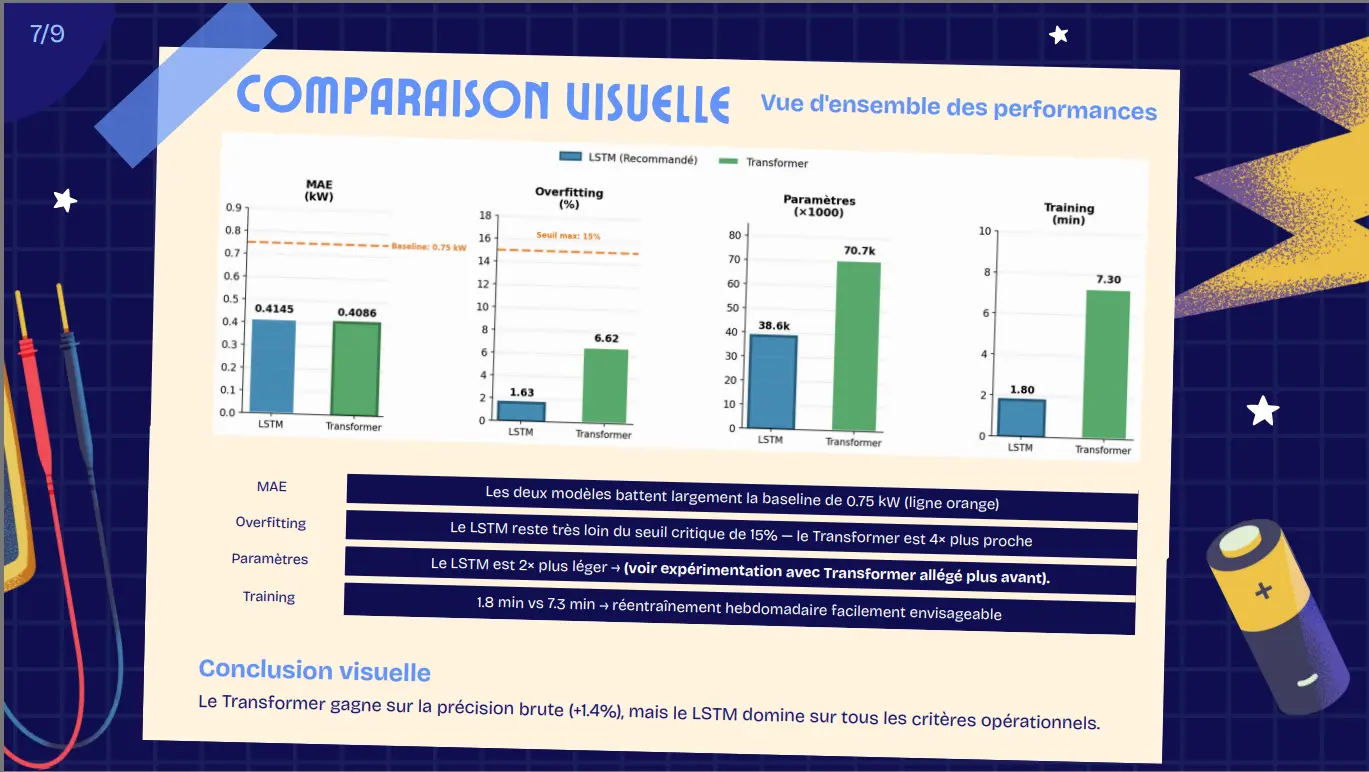

Performances du modèle :

LSTM : MAE 0,4145 kW, écart d’overfitting 1,63 %, entraînement 1,8 min

Transformer : MAE 0,4086 kW (+1,4 %), écart d’overfitting 6,62 %, entraînement 7,3 min

Les deux ont atteint l'objectif MAE < 0,5 kW

Importance des caractéristiques : les caractéristiques de décalage (lag_1h : corr. 0,71) et les sous-compteurs dominent ; les caractéristiques météorologiques présentent une faible corrélation (~0,15-0,20)

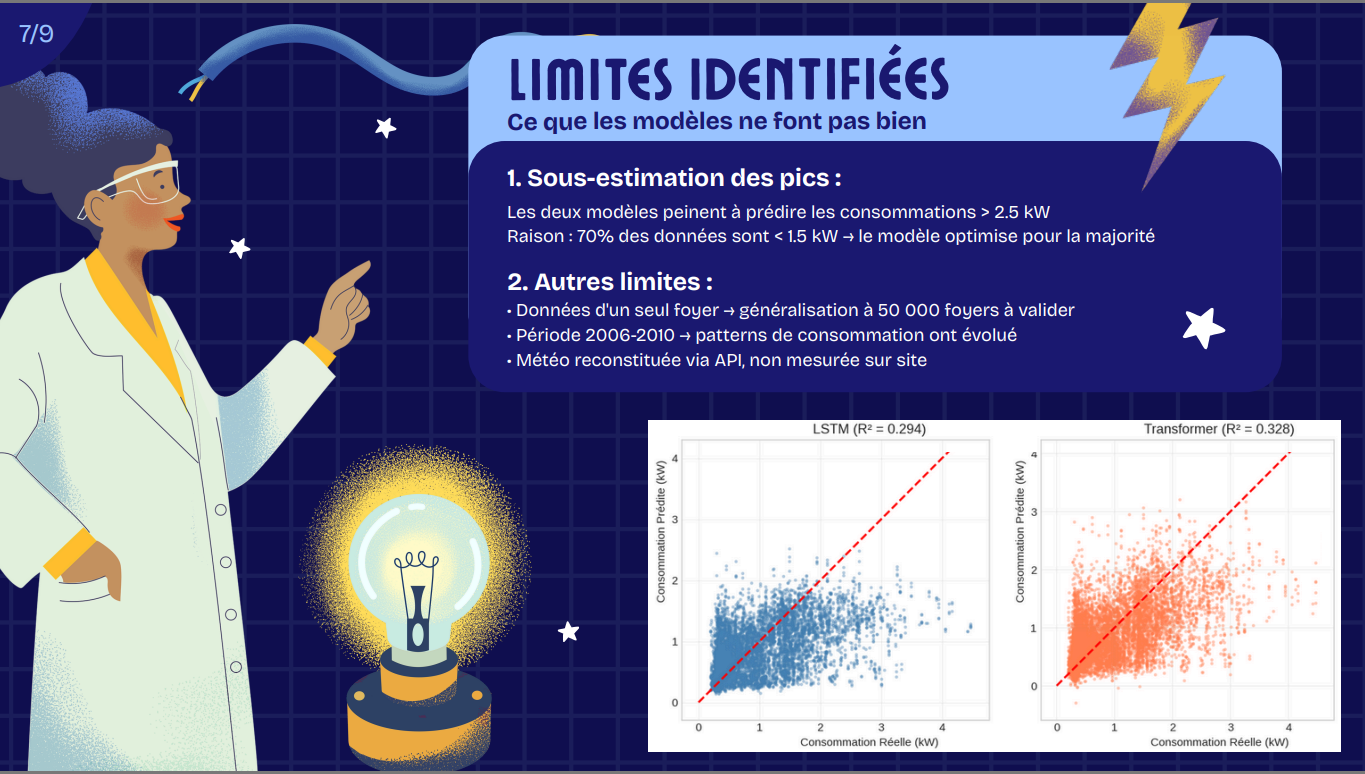

Limites : les deux modèles sous-estiment les pics > 2,5 kW ; un seul foyer limite la généralisation

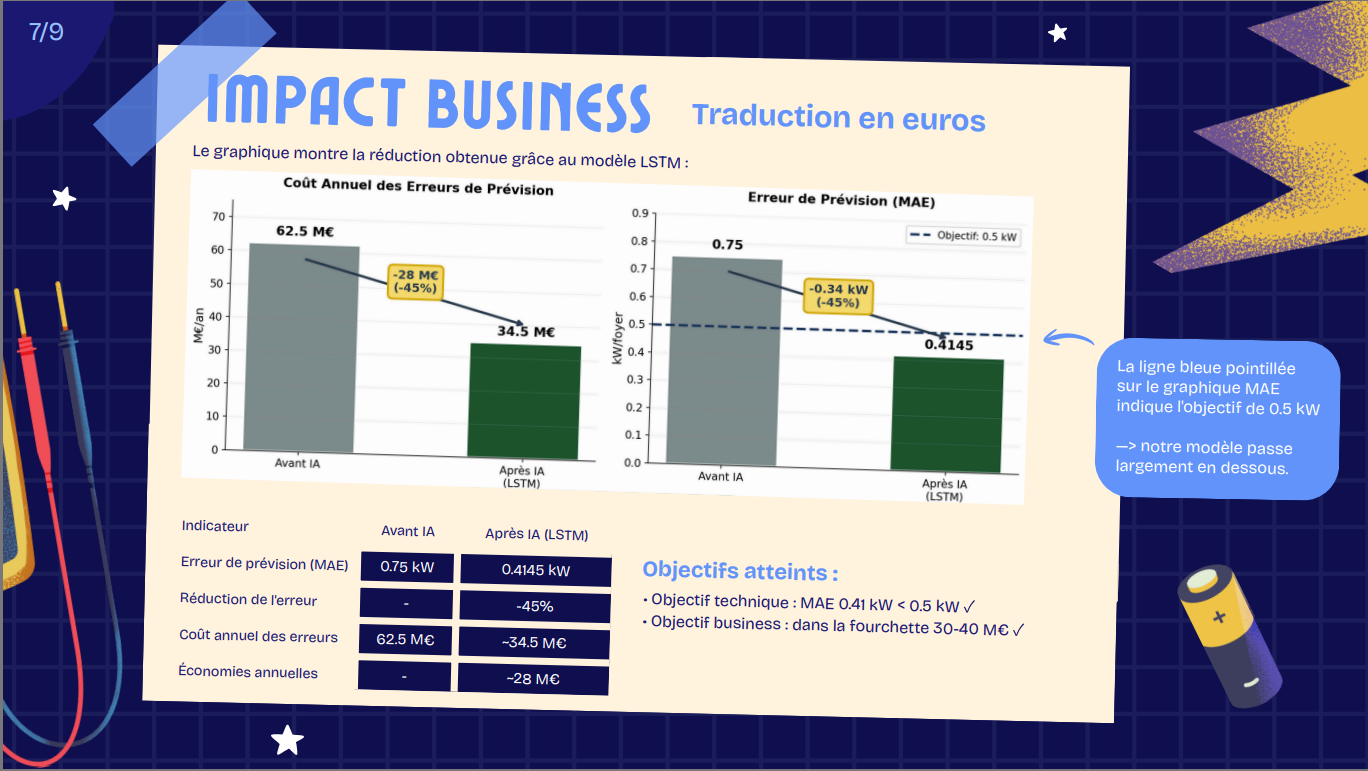

Business Impact

- LSTM recommandé pour la production : overfitting 4 fois moins important, réentraînement plus simple et plus rapide.

- Réduction des erreurs : 45 % (MAE 0,75 → 0,4145 kW)

- Économies annuelles estimées : environ 28 millions d'euros

- Feuille de route de déploiement : projet pilote sur 5 000 foyers pour 3 mois, réentraînement hebdomadaire, tableau de bord de surveillance MAE, optimisation des hyperparamètres

- Contribution scientifique : démonstration de la robustesse du LSTM par rapport au Transformer pour la prévision de la consommation énergétique résidentielle, avec de datasets plus modestes.

Links

Notebook (Feature Engineering & Modeling)